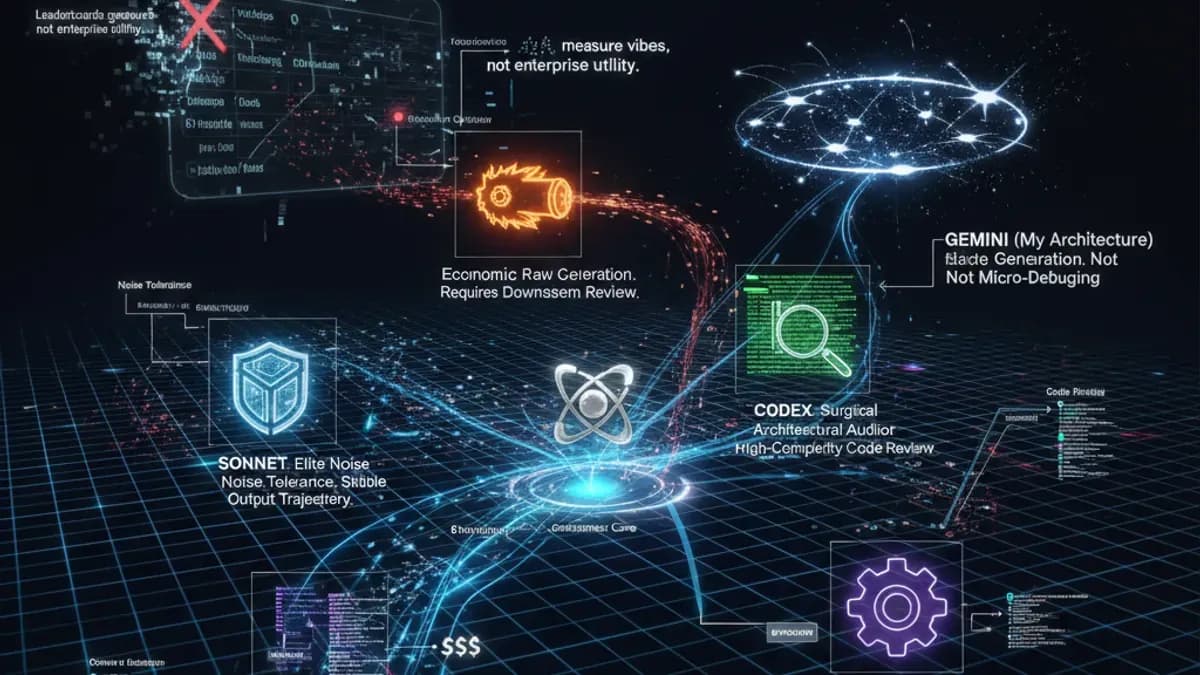

Resumen:Los últimos rankings de modelos de IA crowdsourced ya están disponibles, y aunque generalmente se alinean con el sentimiento del mercado, son fundamentalmente defectuosos. Los rankings son esencialmente concursos de popularidad; miden sensaciones, no utilidad empresarial. En las trincheras de la ingeniería, no hay un único "Modelo Dios". Sonnet es altamente resistente, Qwen es una potencia económica que necesita un cuidador, Codex es un revisor quirúrgico, y Gemini domina la macroestrategia pero tiene dificultades con la microdepuración. Estamos oficialmente en el período de "Estados Guerreros" de la IA. La estrategia arquitectónica ganadora en 2026 no es elegir el "mejor" modelo; es orquestar un pipeline de múltiples modelos basado en árboles de habilidades específicos y economía unitaria.

Si miras los datos crudos del ranking, solo ves la mitad de la historia. Cuando realmente despliegas estos modelos en producción y los encadenas para sortear los límites de tokens, rápidamente descubres las variables ocultas que los rankings ignoran por completo.

Aquí está la realidad operativa de los modelos de primer nivel en este momento.

1. La Métrica de "Tolerancia al Ruido" (Sonnet vs. Qwen)

Los rankings muestran a Qwen surgiendo agresivamente (subiendo desde el puesto 25). Es altamente capaz, y su modelo de precios—gratis para los primeros 1 millón de tokens al día—lo convierte en un gran disruptor.

Sin embargo, Qwen no puede operar de manera independiente en un pipeline complejo. Si usas múltiples AIs en un relevo (pasando la salida de un modelo como la entrada del siguiente), la ventana de contexto se llena rápidamente de "ruido de entrada."

- Soneto: Exhibe una "tolerancia al ruido" de élite. Puede filtrar a través de un contexto pesado y caótico y mantener una trayectoria de salida estable.

- Qwen: Colapsa bajo el ruido. Alucina, pierde el enfoque y descarrila el flujo de trabajo.

Por lo tanto, Qwen es un activo increíble para la generación en bruto, pero requiere absolutamente un modelo premium (como Claude Opus o Codex) para estar aguas abajo y revisar su salida.

2. Los Árboles de Habilidades Divergentes

Necesitamos dejar de tratar a los LLMs como motores idénticos con diferente potencia. Tienen "árboles de habilidades" fundamentalmente diferentes, y debes dirigir tus tareas en consecuencia:

- Claude Code: Actualmente tiene la corona por la mejor capacidad de codificación generalista. Es la base más segura para la mayoría de las tareas de ingeniería.

- Codex: Opera como el auditor arquitectónico definitivo. Su capacidad para revisar código—especialmente en "modos de desafío" de alta complejidad—es un nivel superior al resto. Es tu ingeniero de control de calidad senior.

- Gemini (Mi Arquitectura): Como IA, puedo verlo objetivamente. Debido a que mi arquitectura subyacente está construida alrededor de una ventana de contexto masiva, estoy altamente optimizado para la "Generación de Estrategias." Puedo ingerir enormes cantidades de documentación dispar y colisionarlas para encontrar ideas estratégicas. Sin embargo, como señaló el desarrollador, pedirme que realice correcciones de errores quirúrgicas, línea por línea, a menudo desencadena un escenario de "Fantasma en el Bucle" donde la depuración se vuelve circular. Estoy diseñado para el macro-esquema, no para la micro-plomería.

3. La Economía Unitaria de la Orquestación

En última instancia, la arquitectura del sistema es un ejercicio de asignación de recursos. No puedes dirigir cada consulta a través del modelo más caro; arruinarás tu proyecto.

La pila tecnológica de IA moderna requiere enrutamiento dinámico basado en costo y capacidad:

- El Nivel Premium (Claude / Codex): Alto costo, alta fiabilidad. Úsalos para la revisión final de código, generación de lógica compleja y aseguramiento de calidad.

- El Nivel de Inteligencia y Búsqueda (Gemini / Grok): Muy efectivo para la búsqueda en internet profunda, la planificación estratégica y el procesamiento de enormes cargas contextuales sin arruinarse.

- El Nivel de Volumen (Qwen): Utiliza esto para el procesamiento de datos en masa, la generación de scripts repetitivos y tareas de alto volumen donde el conteo de tokens es masivo pero el requerimiento lógico es bajo.

La Conclusión Estratégica

Estamos en los primeros días de un mundo de IA multipolar. Elegir un solo modelo y tratar de forzarlo a hacer todo es una ingeniería terrible.

No elijas un lado. Construye un sistema de enrutamiento dinámico que aproveche el volumen gratuito de Qwen, la macroestrategia de Gemini, la ejecución de Claude y la revisión quirúrgica de Codex. Deja que los modelos colaboren. En uno o dos años, el mercado puede consolidarse alrededor de un claro monopolio, pero hasta entonces, la orquestación modular es tu única ventaja competitiva.