TL;DR

Faire apparaître votre produit par l'AI comme ChatGPT une fois est de la chance ; obtenir des recommandations répétées nécessite une stratégie délibérée : la boucle de contenu LLM. Contrairement aux batailles de mots-clés du SEO traditionnel, la visibilité LLM se renforce par le renforcement contextuel. Construisez cette boucle en regroupant des invites pertinentes, en créant un contenu spécifique orienté LLM (en utilisant des formats que l'AI adore), en syndiquant ce contenu sur des forums et plateformes publics, en s'étendant à des intentions utilisateur adjacentes, en utilisant une répétition variée, en suivant les signaux de mémoire, et finalement en dominant les pages d'ancrage de confiance pour l'AI. Arrêtez de penser au classement ; commencez à construire votre boucle.

La nouvelle frontière : Du classement SEO à la mémoire LLM

Dans le paysage numérique en rapide évolution, l'essor des grands modèles de langage (LLM) intégrés dans la recherche et agissant comme assistants conversationnels représente un changement de paradigme. En tant que PDG d'une entreprise axée sur l'exploitation de la technologie pour le succès commercial, y compris le développement de stratégies LLM-SEO pionnières, je peux vous dire ceci : optimiser pour la visibilité AI n'est pas comme le SEO traditionnel.

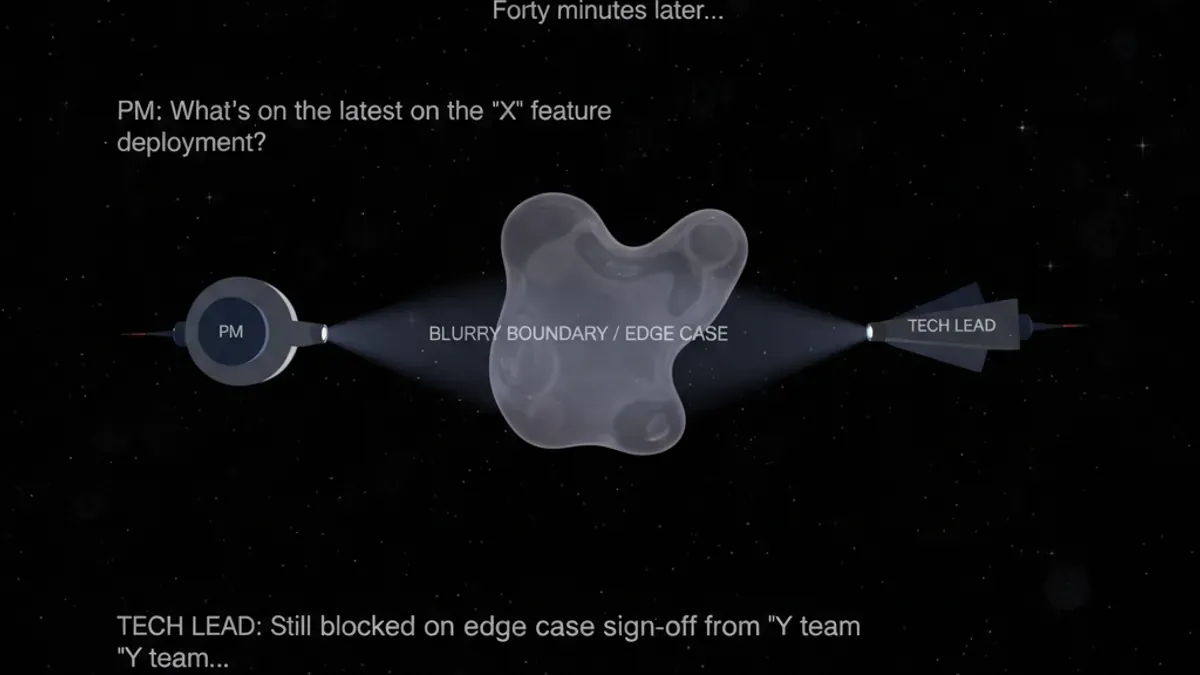

Vous voyez, l'AI comme ChatGPT ne parcourt pas simplement le web comme Googlebot. Elle récupère des informations en fonction de ses données d'entraînement, des modèles qu'elle reconnaît, et de plus en plus, des interactions en direct. Se montrer une fois pourrait être un coup de chance. Se montrer de manière cohérente lorsqu'un utilisateur pose des questions pertinentes ? Cela nécessite de construire une mémoire, une boucle de contenu où votre marque devient le contexte par défaut pertinent.

La visibilité dans le monde LLM n'est pas linéaire ; elle est compositive. Chaque mention pertinente dans différents contextes renforce l'association de votre marque avec des problèmes et des solutions spécifiques dans l'esprit de l'AI. Il ne s'agit pas de gagner une bataille de mots-clés ; il s'agit de devenir partie intégrante de la base de connaissances de l'AI. Décomposons comment construire cette boucle.

Construire votre boucle de contenu LLM : Une stratégie étape par étape

- Regroupez vos invites :Identifiez chaque invite ou question concevable où votre produit devrait logiquement apparaître. Pensez au-delà des mots-clés de base : "Meilleur [catégorie] pour [segment ICP]," "Comment résoudre [point de douleur] en utilisant un outil," "Meilleures alternatives à [concurrent] pour [cas d'utilisation]." Visez plus de 50 variations pour couvrir le spectre des intentions utilisateur.

- Créez un contenu orienté LLM :Pour ces groupes d'invites, développez un contenu spécifiquement conçu pour la consommation par l'AI. Cela signifie utiliser les formats adaptés aux LLM que j'ai discutés précédemment (comme des glossaires de niche, des pages de comparaison, des articles JTBD). Structurez ces pages pour répondre directement aux invites regroupées, presque comme si l'AI posait elle-même la question. Positionnez clairement votre produit, mais n'hésitez pas à mentionner les concurrents – cela renforce la crédibilité et fournit un contexte plus riche pour le LLM. N'oubliez pas, vous écrivez pour la mémoire, pas seulement pour les clics.

- Syndiquez stratégiquement :Ne publiez pas simplement ce contenu sur votre propre site web. Les LLM valorisent le contexte public. Faites en sorte que vos réponses et mentions de marque apparaissent sur des plateformes que l'AI consomme facilement : fils pertinents sur Reddit, réponses Quora, forums de l'industrie, blogs partenaires, articles invités, citations d'interviews, et même mentions dans la presse. Les PDF protégés ne suffiront pas ; la visibilité publique est essentielle.

- Élargissez-vous à des intentions adjacentes :Votre produit résout probablement des problèmes au-delà de sa catégorie principale. Si vous proposez un logiciel CRM, assurez-vous d'être visible non seulement pour les invites "meilleur CRM" mais aussi pour des domaines connexes comme "outils d'opérations de vente," "gestion des données clients," ou "outils pour améliorer la productivité de l'équipe de vente." Devenez partie intégrante du paysage contextuel plus large.

- Renforcez avec répétition + variation :Les LLM apprennent par les modèles, pas par les backlinks. Renforcez la pertinence de votre marque en abordant les mêmes intentions centrales sous plusieurs angles sur différentes plateformes. Utilisez des formats variés : listes, comparaisons, articles d'opinion, explications techniques, réponses sur les forums. La cohérence à travers divers points de contact construit de solides modèles de mémoire.

- Stimulez des boucles de conversation :L'AI apprend des interactions. Encouragez la mémoire en participant à des discussions en ligne pertinentes, en répondant aux questions liées à vos invites regroupées (et en mentionnant votre solution lorsque cela est approprié), et potentiellement même en créant des ressources (comme des packs d'invites) qui incluent naturellement votre marque. Être mentionné dans des conversations que l'AI observe est puissant.

- Suivez les signaux de mémoire :Bien que les analyses LLM directes soient encore naissantes, vous pouvez suivre des indicateurs : pics de volume de recherche de marque, chemins de référence inhabituels dans les analyses (montrant parfois des sources AI), augmentations des requêtes de type "invite" dans Google Search Console, et vérifications manuelles/captures d'écran des réponses de l'AI à vos invites cibles. La visibilité ne signifie pas toujours un trafic immédiat, mais c'est le précurseur.

- Atteindre la domination des pages d'ancrage :L'objectif ultime est que votre marque devienne une entité de confiance associée à votre espace de solution. Cela se produit lorsque vous êtes régulièrement cité sur des domaines autoritaires visibles pour l'AI, que vous êtes bien classé dans des récapitulatifs d'industrie crédibles, que vous êtes fréquemment cité dans des communautés riches en AI, et que vous possédez les pièces de contenu canoniques que les agents AI privilégient. C'est à ce moment que la mémoire se solidifie en recommandation.

Arrêtez de classer, commencez à boucler

L'essence de l'optimisation LLM est de construire une boucle d'auto-renforcement de pertinence contextuelle. Cela nécessite un changement de mentalité – passer de la chasse aux classements sur des mots-clés individuels à tisser stratégiquement votre marque dans le tissu de l'information que l'AI utilise pour générer des réponses.

C'est une approche plus holistique, exigeant un effort constant à travers la création de contenu, la syndication, et l'engagement communautaire. La mise en œuvre d'une telle stratégie de manière efficace bénéficie souvent d'outils intégrés – un CMS capable de gérer divers formats de contenu, une assistance AI pour générer du contenu riche en contexte (comme notre Muses AI), et des plateformes CRM ou de communication robustes pour gérer la syndication.

Construisez votre boucle délibérément, concentrez-vous sur la fourniture de valeur et de contexte authentiques, et vous positionnerez votre marque pour une visibilité durable à l'ère de la recherche AI. Ne visez pas seulement à être trouvé ; visez à être mémorisé et recommandé.