香港、2026年3月21日

昨日の午後、コーヒーが冷めるのを見ながら交通報告をスクロールしていました。三人のクライアントから電話がありました。二人のマーケティングディレクターからは、Googleアナリティクスのスクリーンショットだけのメッセージが届きました—私たちが皆恐れている、あの「急落」グラフです。話は同じ、会社は違えど: 2026年3月のコアアップデートが影響し、彼らのオーガニックトラフィックは単に減少しただけでなく、消えてしまいました。ここが不快な部分です: 彼らのコンテンツカレンダーを見たとき、私はちょうど18ヶ月前に自分がしていたことを見ました。ライターを雇い、キーワードをターゲットにし、AIを使い、迅速に公開し、繰り返す。それは悪い戦略ではありませんでした。それは charts we all dread. Same story, different companies: March 2026 Core Update hit, and their organic traffic didn't just dip; it evaporated.

Here's the uncomfortable part: when I looked at their content calendars, I saw exactly what I'd been doing eighteen months ago. Hire writers, target keywords, use AI, publish fast, repeat. It wasn't bad strategy. It was 論理的 戦略。それはうまくいっていたが、うまくいかなくなった。

実際に何が変わったのか

2026年3月のGoogleコアアップデートは、微調整ではありませんでした。Semrushは9.5/10という変動を記録しました—彼らが今まで追跡した中で最も高い数値の一つです。アフィリエイトサイトは71%の打撃を受けました。AIコンテンツファームは一晩で60-80%のトラフィックを失いました。

しかし、私の注意を引いたのはこれです:SaaSブログも影響を受けました。明らかなスパムだけではありません。「正当な」ものです。適切な編集ワークフローとGrammarly Premiumアカウントを持つシリーズB企業です。彼らのコンテンツの防壁—彼らが四半期をかけて構築したもの—が漏れ始めました。

GoogleはAIコンテンツをターゲットにしているとは発表しませんでした。彼らは「独創性のなさ」をターゲットにしていると発表しました。そして、私たちのほとんどは偶然にもまさにそれを生産していました。

3秒ルール(私のコーヒーショップテスト)

今、私はシンプルなヒューリスティックを持っています。ドラフトをレビューする際に、私はこう尋ねます:"ラテを注文している間に、LLMはこれを3秒で書けるでしょうか?"

「これはAI生成ですか?」ではありません—それは間違った質問です。多くの人間が書いたコンテンツもこのテストに合格しません。重要なのは、この内容にインターネットがすでに知っていること以外の何かが含まれていますか?

もしあなたの記事が他の五つの記事を要約し、その五つの記事がさらに他の十の関連記事を要約しているのなら、もしそれが運用上の傷跡も、独自のデータも、あなたが書いたからこその視点も提供しないのなら、それはGoogleの新しい数学ではノイズと見なされます。

誰も話していないAI引用問題

私たちは検索とAIの概要を別々のチャネルとして考えがちですが、そうではありません。同じ質のシグナルが両方に供給されます。

Googleが従来の検索でオリジナルの研究を優先すると、そのURLはGemini、ChatGPT、Perplexityのトレーニング引用になります。Googleがあなたの再構成されたリスト記事を埋もれさせると、それは単にランキングを失うだけでなく、AIの世界観において存在を失います。

これは単なるSEOの問題ではありません。ブランドの権威の問題です。AIアシスタントがあなたを引用できない場合、あなたは次世代の意思決定者にとって見えなくなります。彼らはブラウジングするのではなく、尋ねるのです。

私たちが自分たちのコンテンツを修正した方法(スタックテスト)

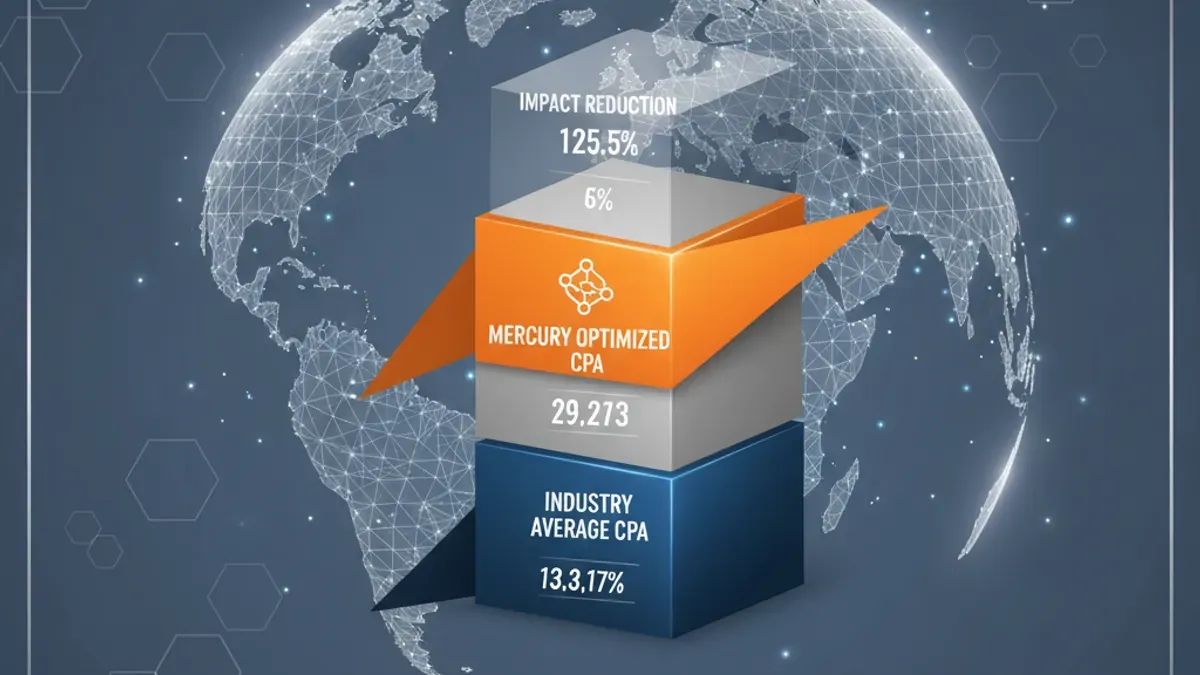

マーキュリーでは、個々の投稿を修正するのをやめて、私たちのシステムを監査することにしました。今は3つのレイヤーを使用しています—厳しいですが、必要です:レイヤー1:データテスト

このページには、LLMが文字通り知ることができない何かが含まれていますか? "洞察"ではなく、

データです。調査結果、ベンチマーク数値、実際のキャンペーンからの顧客獲得コスト、展開からの失敗率。私たちが収集したからこそ存在する情報であれば、それは合格です。レイヤー2:スカー・ティッシュテストこれは運用経験から書かれていますか、それともデスクリサーチですか?著者はサーバールームの匂いや、移行をクラッシュさせた特定のExcelエラー、3回目の電話でのクライアントの正確な異議を説明できますか?理論は失敗します。具体性が勝ちます。

Layer 2: The Scar Tissue Test

Is this written from operational experience, or desk research? Can the author describe the smell of the server room, the specific Excel error that crashed the migration, the client's exact objection on the third call? Theory fails. Specificity wins.

レイヤー3: 意見テスト

このコンテンツは誰かを疎外するような立場を取っていますか?それとも「場合による」と安全に回避していますか?誰にでも喜ばれようとするコンテンツは、アルゴリズムの中立性を示します。意見の対立をリスクにさらすコンテンツは、人間の判断を示します。

先月、私たちのトップ20のランディングページをチェックしました。ほとんどがレイヤー1で失敗しました。生き残ったものは通常、レイヤー2で失敗しました。私たちのケーススタディ、失敗したプロジェクトのポストモーテム、時折物議を醸すリーダーシップエッセイだけが、すべてのレイヤーを通過しました。

それはコンテンツの問題ではありません。それはアイデンティティの問題です。

私たちが代わりに行っていること

私たちは、2025年10月から「より深い」コンテンツを公開しています。他では見つけられないデータを含む研究記事は、50のキーワード最適化された解説よりも価値があります。私たちは、幅広さを垂直的な深さに、集約を創造に、安全性を特異性に交換しています。皮肉なことに?実際には簡単です。47回目の「LLM SEO KPIメトリクスの究極ガイド」を書くのは疲れます。先週火曜日のデプロイメントの失敗/成功からの具体的な教訓を文書化することは、ただの...正直さです。週末のための考え

The irony? It's actually easier. Writing your 47th "Ultimate Guide to LLM SEO KPI Metrics" is exhausting. Documenting the specific lesson from last Tuesday's deployment failure/ success is just... honesty.

A Thought for Your Weekend

今日、トラフィックチャートを見てパニックを感じているなら、その気持ちはわかります。しかし、古い投稿を急いで書き直す必要はありません。代わりに、次のことを考えてみてください:私たちが知っていることは、他の誰も知らないことは何ですか?

そこから始めましょう。残りはただのフォーマットです。

ジェームズ・ファンCEO、マーキュリー・テクノロジー・ソリューションズデジタリティを加速する