台灣,2026年3月21日

我昨天下午一邊喝著冷掉的咖啡,一邊翻閱流量報告。三位客戶打來電話。兩位行銷總監發來的訊息只是谷歌分析的截圖——那些我們都害怕的「熟悉的懸崖式下降」圖表。相同的故事,不同的公司:2026年3月核心更新來襲,他們的自然流量不僅僅是下降,而是蒸發了。這裡有一個不舒服的部分:當我查看他們的內容日曆時,我看到的正是我十八個月前所做的事情。聘請寫手、鎖定關鍵字、使用AI、快速發布、重複。這不是壞策略。這是 charts we all dread. Same story, different companies: March 2026 Core Update hit, and their organic traffic didn't just dip; it evaporated.

Here's the uncomfortable part: when I looked at their content calendars, I saw exactly what I'd been doing eighteen months ago. Hire writers, target keywords, use AI, publish fast, repeat. It wasn't bad strategy. It was 邏輯的 策略。這個方法在有效時運行,直到它不再有效。

實際上改變了什麼

谷歌2026年3月的核心更新不是一次微調。Semrush記錄的波動性達到9.5/10——這是他們追蹤過的最高數值之一。聯盟網站遭受了71%的損失。AI內容農場在一夜之間失去了60-80%的流量。

但這裡有一點引起了我的注意:SaaS博客也受到了影響。不僅僅是明顯的垃圾郵件。還有那些「合法的」網站。那些擁有適當編輯流程和Grammarly Premium帳戶的B輪公司。他們花了幾個季度建立的內容護城河開始出現漏洞。

谷歌並沒有宣布他們正在針對AI內容。他們宣布他們正在針對不原創性。而我們大多數人不小心地正好在生產這種內容。

三秒規則(我的咖啡店測試)

我現在有一個簡單的啟發式方法。當我在審查草稿時,我會問:"大型語言模型能在我點拿鐵的三秒內寫出這個嗎?"

不是「這是人工智慧生成的嗎?」——那是錯誤的問題。許多人寫的內容也未能通過這個測試。問題是:這是否包含網際網路上已知的任何資訊?

如果你的文章總結了五篇其他文章,而這五篇又總結了十篇其他文章,如果它沒有提供任何操作上的傷痕、專有數據,或是因為你寫了它而存在的觀點——那麼谷歌的新算法會將其視為噪音。沒有人在談論的人工智慧引用問題我們傾向於將搜尋和人工智慧概述視為兩個不同的渠道。事實上,它們不是。相同的質量信號同時影響兩者。

當谷歌在傳統搜尋中提升原創研究時,那些網址成為Gemini、ChatGPT、Perplexity的訓練引用。當谷歌將你的重複列表埋沒時,它不僅失去排名——它在人工智慧的世界觀中失去了存在。

這不僅僅是SEO問題。這是品牌權威問題。如果人工智慧助手無法引用你,你將對下一代的決策者變得無形,他們不再瀏覽——他們會詢問。

When Google elevates original research in traditional search, those URLs become the training citations for Gemini, ChatGPT, Perplexity. When Google buries your rehashed listicle, it doesn't just lose ranking—it loses existence in the AI's worldview.

This isn't just an SEO problem. It's a brand authority problem. If AI assistants can't cite you, you become invisible to the next generation of decision-makers who don't browse—they ask.

我們如何修正自己的內容(堆疊測試)

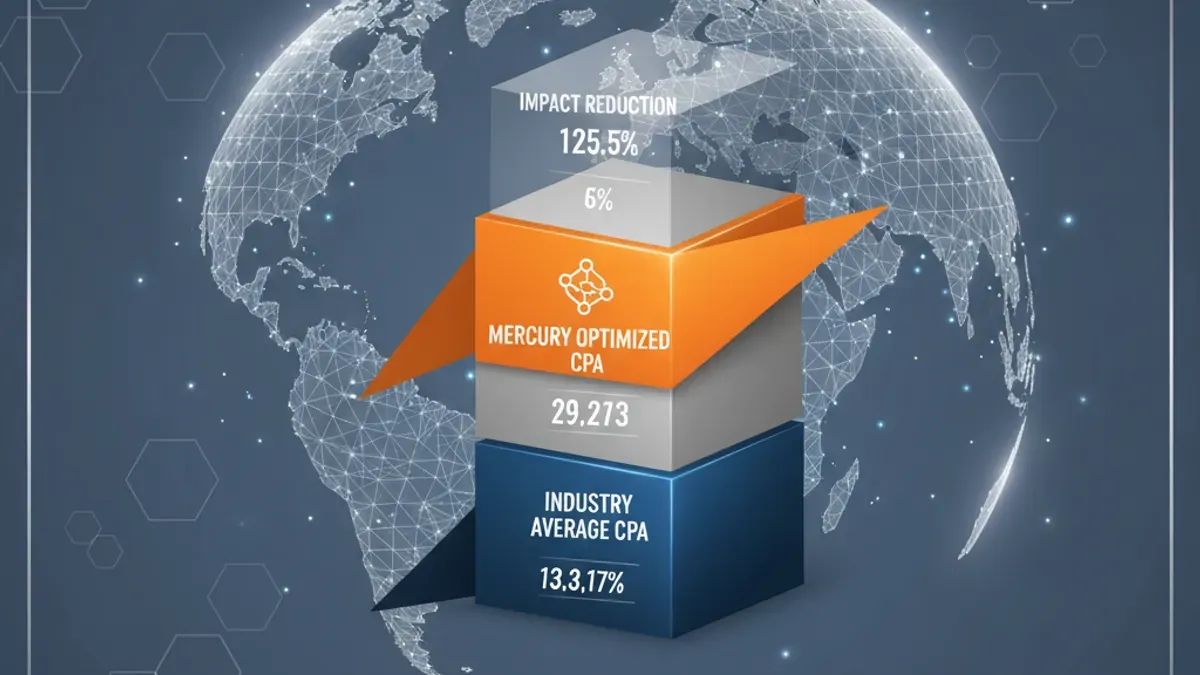

在Mercury,我們停止修正單獨的文章,開始審核我們的系統。我現在使用三個層級——殘酷,但必要:

層級 1:數據測試

這個頁面是否包含LLM根本無法知道的內容?不是「洞察」——數據。調查結果、基準數字、實際活動的獲客成本數據、部署的失敗率。如果這是僅因為我們收集而存在的信息,它就通過了。

層級 2:傷疤測試

這是基於操作經驗寫的,還是桌面研究?作者能否描述伺服器室的氣味、導入過程中崩潰的特定Excel錯誤、客戶在第三通電話中的具體反對意見?理論失敗,具體性勝出。

第 3 層:意見測試

這篇文章是否表達了一種可能會讓某些人感到疏離的立場?還是它安全地模糊其立場,說「視情況而定」?試圖取悅每個人的內容顯示了算法的中立性。冒著引發爭議的內容則顯示了人類的判斷。

上個月我檢視了我們的前 20 個登陸頁面。大多數未通過第一層。倖存者通常未通過第二層。只有我們的案例研究、失敗專案的後續分析,以及偶爾具有爭議性的領導文章通過了所有三層。

這不是內容問題。這是身份問題。

我們正在做的事情

我們自 2025 年 10 月以來發佈了更深入的內容。一篇擁有其他地方找不到的數據的研究文章,價值超過五十篇關鍵字優化的解釋文章。我們正在以垂直深度取代廣度,以聚合取代創新,以安全性取代具體性。

諷刺的是?這實際上更容易。寫你的第 47 篇「終極指南:LLM SEO KPI 指標」是令人疲憊的。記錄上週二部署失敗/成功的具體教訓只是……誠實。

週末的思考

如果你今天在查看你的流量圖表時感到恐慌,我能理解。但不要急著重寫你的舊文章。相反地,問自己:我們知道什麼是別人不知道的?

從這裡開始。其餘的只是格式化。

黃詠昇執行長,水星科技解決方案加速數位化